記事公開日

【生成AI解説つき】特許取得!ハルシネーション・情報漏えいを抑えながら生成AI活用できる「SecuAiGent」とは

ユニリタでは、Waha! Transformerのオプション「生成AI連携オプション」のご提供を終了しました。そして、より使いやすい月額制の生成AIクラウドサービス「SecuAiGent(セキュアイジェント)」が新たに誕生しました。

「SecuAiGent」は「生成AI連携オプション」の技術・特長を引き継ぎ、さらに使いやすく進化させたユニリタの新サービスです。本記事では、生成AIの解説と、「生成AI連携オプション」の技術を振り返りながら「SecuAiGent」のご紹介します。

目次

生成AIとは

生成AIとは

生成AIは、AIの一種で、学習した情報を基に新しい情報やデータを生成できるAIです。従来のAIが学習済みのデータの中から最適な回答や予測結果を出すのに対し、生成AIは新しい情報を、文章、画像、音声、動画、コードなどの多様な形で生成できるのが特徴です。

生成AIの技術

生成AIは、さまざまな技術から成り立っています。以下、5つのキーワードを解説します。

- 基盤モデル(Foundation Model)

- ファインチューニング

- RAG(Retrieval-Augmented Generation:検索拡張生成)

- プロンプトエンジニアリング

- ベクトルデータベース

基盤モデル(Foundation Model):大量のデータ(テキスト、画像、音声など)を学習したAI・機械学習モデルで、多様なタスク(対話、画像検索、物体認識など)に対応できる汎用的なAIモデルです。「大規模言語モデル(LLM)」は基盤モデルの一種で、テキストデータ(自然言語)処理に優れており、OpenAIのGPTシリーズ、AnthropicのClaude、GoogleのGemini、MetaのLlama、AmazonのNovaなどが有名です。

ファインチューニング:学習済みのAIモデル(基盤モデル)に直接新しいデータを学習(追加学習)させ、性能を調整する技術です。この追加学習(ファインチューニング)により、基盤モデルを幅広いタスク(対話、画像検索、物体認識などなど)に適応させます。モデルの種類、学習データの量(トークン数)、学習の回数などによってコストが変動します。

RAG(ラグ、Retrieval-Augmented Generation:検索拡張生成):生成AIが回答を生成する際に、学習済みのデータだけでなく外部のデータベースから情報を検索・追加する技術です。より新しい情報や精度の高い回答を生成できるため、ハルシネーション(事実に基づかない情報生成)を減らしたり、追加学習の手間とコストを低減するメリットがあります。

プロンプトエンジニアリング:プロンプトとは、AIに対して指示する命令文や質問文を指し、プロンプトエンジニアリングは、生成AIが高品質な回答を出力できるようにプロンプトを設計、最適化する技術です。AI自体を変更せずに回答精度を向上させます。Zero-shot prompting、Few-shot promptingなど、いくつか代表的な形式があります。

ベクトルデータベース:データ(画像、音声、テキストなど)をベクトル形式(数値の配列として表現する形式)で保存・管理し、照会で利用されるデータベース。RAGの構築に使われています。

生成AIを活用する技術

生成AIを活用するためには、基盤モデルが学習していないデータの追加が必要です。そのための技術が、ファインチューニング、RAGです。

ファインチューニングは特定のデータセットを追加学習させるため、専門分野などニーズに合った特定の領域に最適化させられます。一方でRAGは、外部データベースなどを直接検索するため、過去に学習したデータではなく、リアルタイムで更新されるデータも利用できます。

また、プロンプトエンジニアリングも、モデルの能力を最大限に引き出すために有効な手法の1つです。

生成AI利用の課題

大規模言語モデル(LLM)は、大量データを学習することで文章を理解し、回答を生成しています。自社での開発はコストがかかるため、GPTやGeminiなど、公開されているLLMをAPIを通じて利用するケースが一般的です。そして、基盤モデルが学習済みの情報に加えて自社の情報を学習させることで、生成AIを入り口としたデータ活用の幅が大きく広がります。

しかし、ビジネスでの生成AI利用には、次のような課題があります。

【1】誤った情報の出力

生成AIは誤った情報を出力することがあります。ハルシネーション(Hallucination:幻覚)と呼ばれ、まるで事実のように見える嘘の情報を生成してしまう現象です。

LLMへの事前学習に含まれていない情報や、追加学習で補強されていない領域の情報、学習データの誤りといった学習データが起因するだけでなく、AIが単語やフレーズの関連性から回答を生成するプロセスで、統計的関連性を優先して生成するため、必ずしも事実関係を保証しないことが原因で発生します。技術の進化と共にハルシネーションの内容も高度化し、本当か嘘か見分けがつかないケースもあります。

まるで事実のように見える嘘の情報を生成してしまう「ハルシネーション」

まるで事実のように見える嘘の情報を生成してしまう「ハルシネーション」

【2】学習を通じた情報漏えいリスク

生成AIの学習リスクについて解説します。生成AIは「通常利用時の学習」と、追加学習のための「RAGの構築」に情報漏えいリスクがあります。

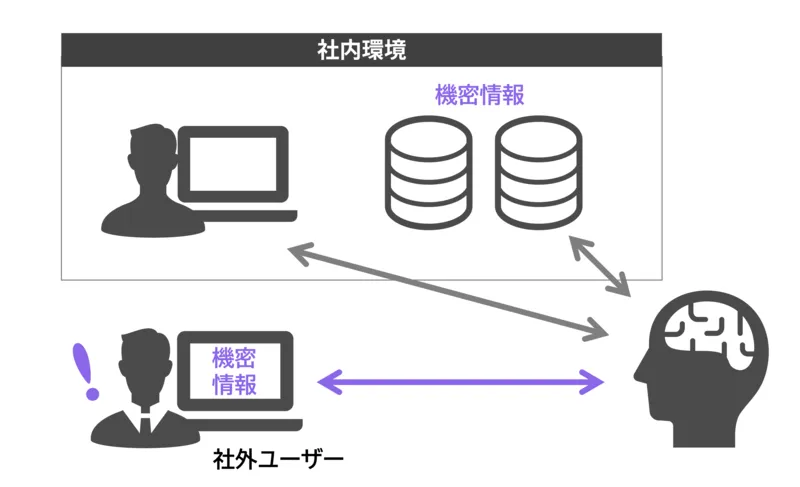

【通常利用時の学習】

生成AIは追加学習をしない場合でも、社内情報を含めて回答を生成する際に、そのデータが生成AI側に送信されます。そのため、生成AIに入力した情報を生成AIが学習し、その情報が他の人がAIに対して質問をする際に使用される可能性があります。

「通常利用時の学習」リスク

「通常利用時の学習」リスク

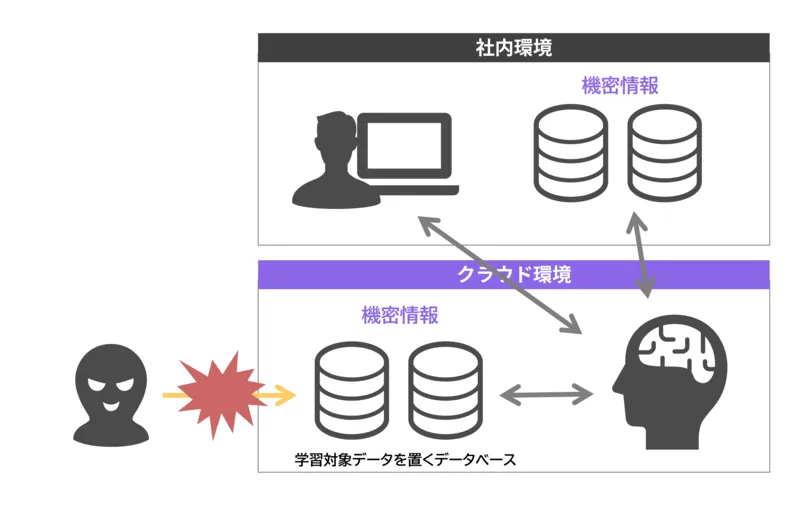

【RAGの構築】

RAGで利用する外部データベース(学習対象データを置くデータベース)をクラウド環境に構築している場合、外部からの攻撃による機密情報流出リスクがあります。また学習対象のデータを(データの欠損がある、正規化されていない等)正しく整備できていない場合、生成AIのユーザーが誤った情報を利用してしまうケースもあります。

「RAGの構築」におけるリスク(外部からの攻撃による機密情報流出リスク)

「RAGの構築」におけるリスク(外部からの攻撃による機密情報流出リスク)

ハルシネーション・情報漏えいを抑えながら生成AI活用できる「SecuAiGent」の技術

ハルシネーション、情報漏えいといったリスクがある生成AIですが、それらを低減させるサービスが、生成AIクラウドサービス「SecuAiGent」です。

SecuAiGentは「ハルシネーションの抑制」と「情報漏えいリスクの低減」を実現する技術を実装しています。※特許取得済み(特許番号: 第7662875号)

「SecuAiGent」が実装している技術をご紹介します。

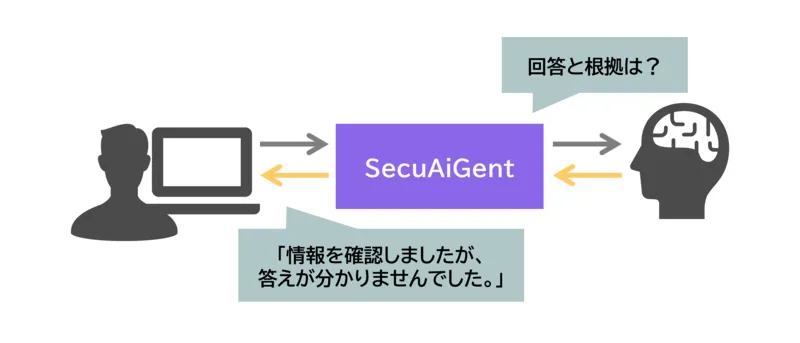

【1】ハルシネーションの抑制

「SecuAiGent」は、生成AIに「回答」だけでなく、その「根拠」を提示させます。さらにその「根拠」を基に、「回答」が質問に適したものか独自のチェック機構により検証します。「根拠」が存在しない、不適切だと判断した場合は「回答がない」旨を利用者に返すことで、ハルシネーションを抑制します。

「SecuAiGent」はハルシネーションを抑制

「SecuAiGent」はハルシネーションを抑制

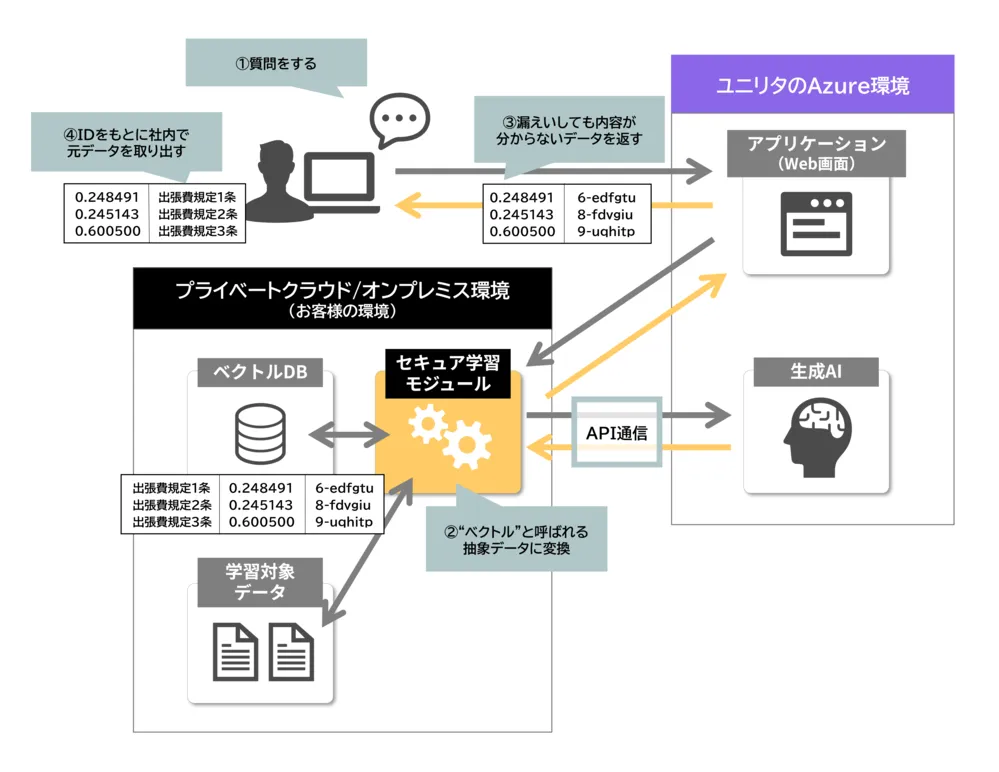

【2】情報漏えいリスクの低減

「SecuAiGent」は、RAGの構築における機密性が高いデータやベクトルデータベースを、プライベートクラウド環境やオンプレミス環境で管理します。

ベクトルデータベースを構築する際に、情報を次の3つに分けて管理します。

- 学習対象データ(機密情報)

- ベクトルデータ

- (A)と(B)を紐づけるID

「SecuAiGent」は(A)学習対象データを数学的に不可逆変換(元の情報に戻せない変換)した(B)“ベクトル”と呼ばれる不可逆な抽象データをベクトルデータベースに登録します。

(C)が、今回「SecuAiGent」が特許を取得した技術の一部です。ユニリタが提供するETLツール「Waha! Transformer」で作成します。

そして、(B)と(C)のみでクラウド上の生成AIとAPI通信します。ユーザーの質問もベクトル化して検索し、ユーザーが生成AIを利用する時のみ、(A)~(C)のデータを突合して回答を作成します。※この突合時にも特許技術を利用します。

そのため、標準的なベクトルデータベースを構築する際と比較し、情報漏えいのリスクが格段に下がります。

「SecuAiGent」は情報漏えいリスクを低減

「SecuAiGent」は情報漏えいリスクを低減

さらに、RAGの構築は、より新しい情報や自社の情報を活用できるため、ハルシネーション抑制効果があります。「SecuAiGent」が持つ【1】の技術とあわせて、さらにハルシネーションを抑制できるメリットがあります。

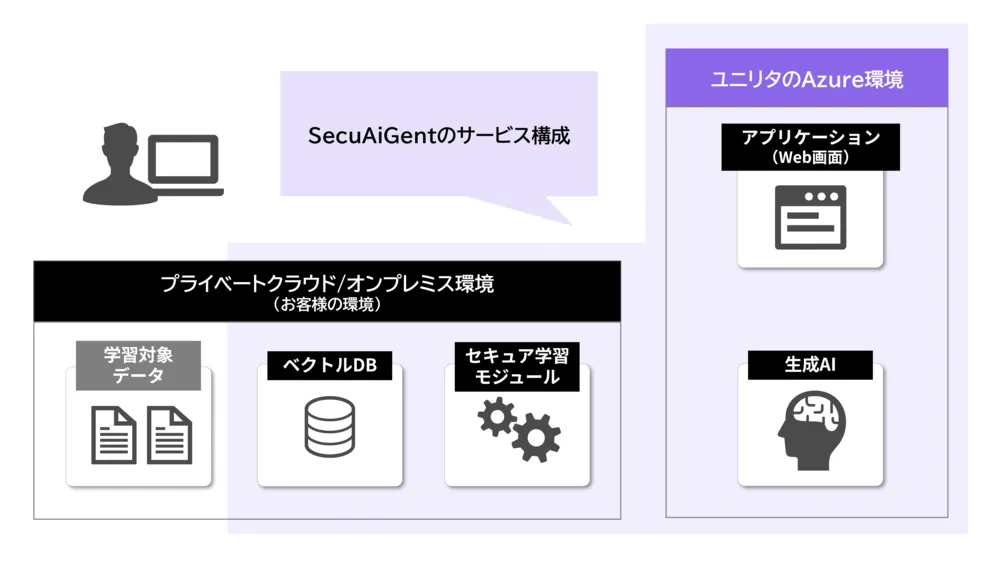

「SecuAiGent」のサービス構成

機密情報を含むRAGの構成は、セキュアなお客様環境に導入します。

「SecuAiGent」のサービス構成

「SecuAiGent」のサービス構成

また、「SecuAiGent」はRAGや生成AIの設定に、専門的な知識を必要とせず、少人数からでも利用可能な月額制(サブスクリプション型)サービスです。

セキュアな環境で、追加学習・学習による情報漏えいリスクを抑え、生成AI活用をしたいとお考えの皆さま、ぜひお気軽にお問い合わせください。

事例:セキュアな生成AI活用で医療現場の効率化を実現!

「SecuAiGent」のセキュアな技術(旧:Waha! Transformer「生成AI連携オプション(β版)」)を活用したお客様事例を、2024年11月に開催された「Waha! Day 2024」でご紹介しております。詳細をぜひアーカイブ配信でご覧ください。

医療ITの未来!セキュアな生成AI活用で医療現場の効率化を実現!

看護師の患者情報収集業務を、「SecuAiGent」の技術(旧:Waha! Transformer「生成AI連携オプション(β版)」)を活用し、効率化した事例を公開しております。また、生成AI利用の課題であった院内情報の漏えいリスクを生成AI利用で解決した方法論についてもご紹介しております。

なお、「SecuAiGent」の概要資料にて、最新の事例情報を公開しております。こちらもぜひご覧ください。

「SecuAiGent」概要資料ダウンロード

https://www.secuaigent.com/download

まとめ

ユニリタの新サービス「SecuAiGent」は、Waha! Transformer「生成AI連携オプション」の技術を継承し、さらに進化させた月額制のクラウドサービスです。このサービスは、生成AIの活用に伴う主要な課題である、「ハルシネーションの抑制」と「情報漏えいリスクの低減」を実現します。

生成AIは、従来のAIと異なり、学習した大量データを基に新しい文章や画像、コードなどを生成する点が特徴です。企業は自社のデータを活用することで、より必要な回答を得られます。

しかし、生成AIは「ハルシネーション」と呼ばれる、まるで事実かのように見える虚偽の情報を生成することがあります。その情報を業務で利用してしまうと、誤った判断や不適切な対応につながる恐れがあります。また、生成AIの学習により、機密情報を交えた回答を外部へ生成したり、クラウド上のRAG環境から情報漏えいするなど機密情報の漏えいリスクが避けられません。

そのような課題に対し、「SecuAiGent」は次のような特長を備えています。

- ハルシネーションの抑制:回答だけでなくその根拠も提示させ、独自のチェック機構で検証することで、ハルシネーションを抑制

- 情報漏えいリスクの低減:追加学習時の学習対象データを外部のクラウド環境にアップロードせず、セキュリティの担保された自社環境内で安全に管理し、情報漏えいリスクを低減

「SecuAiGent」は、生成AIの専門的な知識を必要せず、少人数からでも利用可能な月額制(サブスクリプション型)サービスです。企業がセキュアな生成AI活用を実現するために最適なソリューションです。

ご興味のある方は、ぜひお気軽にご相談ください。

※ユニリタ、「生成AI連携オプション」のセキュア構成に関する特許を取得 生成AIの「正答」と「情報漏洩防止」を両立、より高度な活用を実現

https://www.unirita.co.jp/press/2025/0605_press001.html

関連リンク